Ubuntu 本地部署 Ollama + qwen3.5:9b + OpenWebUI 完全指北

POLISH 「润色·核心由作者完成,AI辅助」

3 分钟阅读

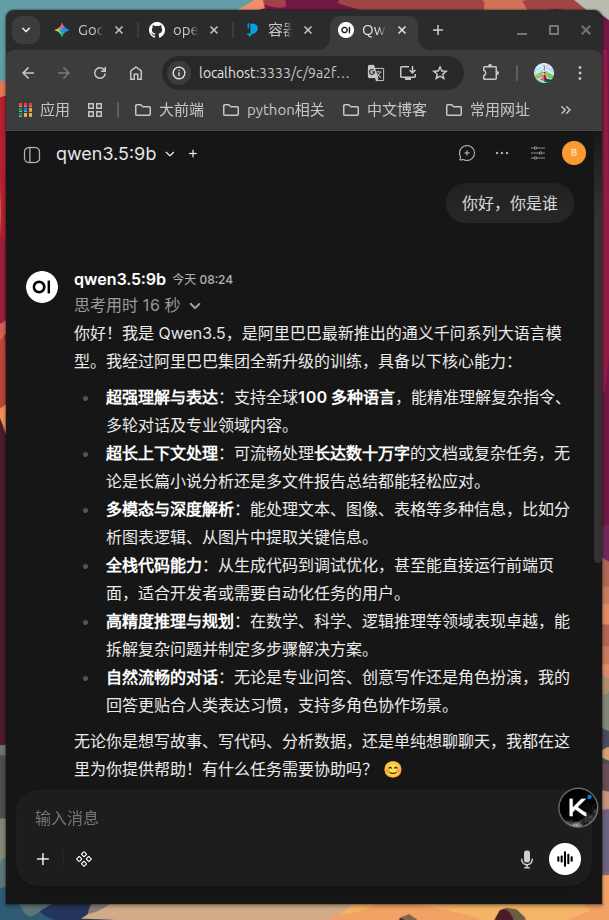

这篇指南将带你从零开始,在 Ubuntu 系统上搭建一套完全私有化、具备高颜值交互界面的 AI 对话系统。我们将使用 Ollama 作为后端引擎,部署阿里最新的 Qwen 3.5 (9B) 模型,并配合 Open WebUI 实现类 ChatGPT 的操作体验。

🚀 部署架构一览

- Ollama: 核心引擎,负责模型的管理与推理。

- Qwen 3.5-9B: 阿里出品的高性能大语言模型。

- Open WebUI: 基于 Docker 部署的前端界面,支持多用户、联网搜索和文档解析。

第一步:安装 Ollama 后端

Ollama 是目前 Linux 平台上部署本地模型最简单的工具。

- 一键安装: 打开终端,执行以下命令:

curl -fsSL https://ollama.com/install.sh | sh

- 验证安装: 安装完成后,检查 Ollama 服务状态:

systemctl status ollama

显示如下就可以证明安装成功:

bosi@bosi:~$ systemctl status ollama

● ollama.service - Ollama Service

Loaded: loaded (/etc/systemd/system/ollama.service; enable>

Drop-In: /etc/systemd/system/ollama.service.d

└─override.conf

Active: active (running) since Wed 2026-03-04 08:18:57 CST>

Main PID: 84301 (ollama)

Tasks: 46 (limit: 76749)

Memory: 17.5M (peak: 1.6G)

CPU: 15min 51.205s

CGroup: /system.slice/ollama.service

└─84301 /usr/local/bin/ollama serve💡 提示:如果你的 Ubuntu 配备了 NVIDIA 显卡,Ollama 会自动安装驱动支持(驱动版本需满足要求),实现 GPU 加速。

第二步:运行 Qwen 3.5 (9B) 模型

Qwen 3.5 是目前开源界的第一梯队,9B 版本在性能和显存占用之间取得了完美的平衡。

- 下载并运行模型: 在终端输入:

ollama run qwen3.5:9b

这条命令会自动从官方库拉取权重文件。下载完成后,你可以直接在终端与它对话。 2. 常用命令参考:

- 查看已下载模型:

ollama list - 删除模型:

ollama rm qwen3.5:9b

第三步:Docker 安装 Open WebUI

为了获得最佳的 UI 体验,我们使用 Docker 部署 Open WebUI。它能自动识别本地的 Ollama 服务。

- 安装 Docker(如果尚未安装):

sudo apt update && sudo apt install docker.io -y

sudo systemctl enable --now docker

- 部署 Open WebUI 容器: 如果你的 Ollama 和 Docker 在同一台机器上,运行以下命令:

docker run -d -p 3000:8080 \

--add-host=host.docker.internal:host-gateway \

-v open-webui:/app/backend/data \

--name open-webui \

ghcr.io/open-webui/open-webui:main

关键参数说明:

-p 3000:8080: 将容器的 8080 端口映射到本地的 3000 端口。--add-host=host.docker.internal:host-gateway: 允许 Docker 容器访问宿主机上的 Ollama 服务。-v open-webui:/app/backend/data: 持久化存储你的聊天记录和设置。

第四步:配置与使用

- 访问界面:

打开浏览器,输入

http://localhost:3000。 - 注册账号: 第一个注册的账号将自动成为管理员。

- 选择模型:

进入页面后,在顶部的模型下拉菜单中选择

qwen3.5:9b。如果列表为空,请检查设置 -> 外部连接里的 Ollama 地址是否配置正确(默认通常为http://host.docker.internal:11434)。

🛠️ 进阶技巧与常见问题

1. 开启远程访问

如果你想在局域网内的其他设备访问这台 Ubuntu 上的 Ollama,需要修改环境变量:

sudo systemctl edit ollama.service

在 [Service] 下方添加:

Environment="OLLAMA_HOST=0.0.0.0"

保存后重启服务:sudo systemctl daemon-reload && sudo systemctl restart ollama

常见错误

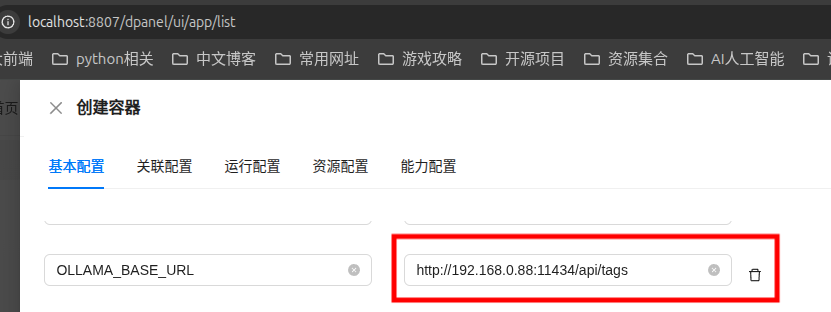

如果Open WebUI 一直链接不上本地的ollama,那一定是容器无法通过网络访问本地的ollama,除了上边的ollama开启远程访问之外还要设置容器中的ollama外网IP,我是在的DPanel 面板里直接修改的容器环境变量具体入下图:

修改成自己的局域网IP就好了!

2. 硬件建议

- 内存: 运行 9B 模型建议至少 16GB 内存。

- 显存: 显存大于 8GB(如 RTX 3060/4060 及以上)可获得极速流式输出;若显存不足,Ollama 会自动切换到 CPU 模式。

结语

至此,你已经拥有了一个完全属于自己的本地 AI 工作站。没有 Token 费用,没有隐私泄露,断网也能用!